Nel campo delle scienze sociali e del comportamento, le conclusioni degli studi scientifici possono variare drasticamente a seconda di chi conduce l’analisi e di come vengono interpretati i dati. A mostrarlo è un’indagine pubblicata su Nature che ha coinvolto 457 analisti indipendenti provenienti da istituzioni di tutto il mondo: al termine di 504 rianalisi di 100 studi precedentemente pubblicati, solo in un terzo dei casi sono emersi gli stessi risultati.

"Questa indagine non mette in discussione la credibilità delle ricerche precedenti, ma richiama l’attenzione sul fatto che ignorare la variabilità analitica può portare a una fiducia ingiustificata nelle conclusioni scientifiche", commenta Matteo M. Marini, assegnista di ricerca al Dipartimento di Scienze Economiche dell’Università di Bologna, che ha partecipato allo studio. "L’oggettività scientifica non sta nell’identificare un’unica analisi 'vera', ma nel rendere trasparente lo spazio delle alternative plausibili, sia nei rapporti di ricerca che nella comunicazione con la più ampia comunità scientifica".

Negli ultimi anni, la ricerca nel campo delle scienze sociali e del comportamento ha visto l'introduzione di diverse novità pensate per rendere il lavoro di analisi più trasparente, rigoroso e affidabile. Tra queste c'è ad esempio la "preregistrazione", che prevede una dichiarazione da parte dei ricercatori delle ipotesi e dei metodi previsti per lo studio prima che i dati vengano raccolti e analizzati. Un'ulteriore evoluzione è poi quella dei "registered reports": modelli di preregistrazione che prevedono diversi passaggi e numerose revisioni del protocollo di ricerca. Inoltre, sono sempre più diffusi gli studi di replicazione e i controlli di riproducibilità delle indagini: tutti strumenti pensati per ridurre il rischio di ottenere risultati casuali o distorti.

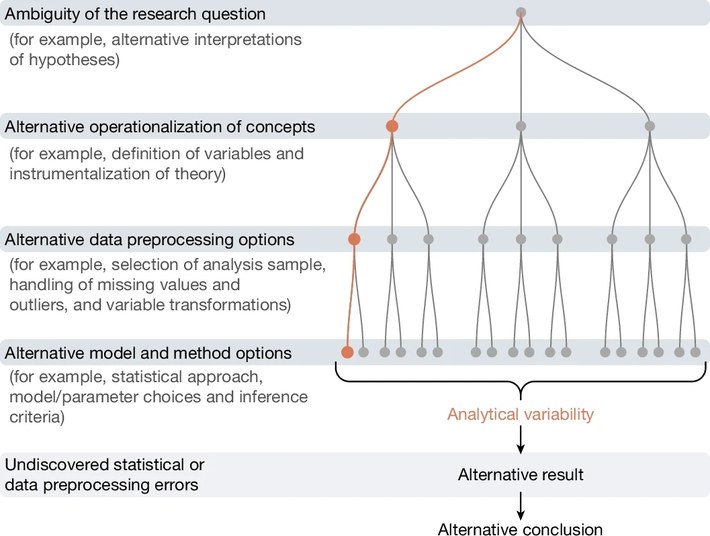

In questo contesto, però, un'altra importante questione ha ricevuto meno attenzione: in che misura i risultati degli studi dipendono dal modo specifico in cui i dati vengono analizzati? Nella pratica scientifica standard, un set di dati viene tipicamente analizzato da un singolo ricercatore o da un gruppo di ricerca. Da questo lavoro di analisi nasce poi una pubblicazione scientifica che presenta l'esito del particolare percorso analitico scelto. C’è poi anche il passaggio della “revisione tra pari” che, sebbene valuti l’accettabilità metodologica, di norma non mette in luce quali risultati avrebbero potuto emergere in presenza di scelte alternative.

“Il lavoro di analisi comporta numerose scelte: come pulire i dati, come definire le variabili, quali modelli statistici o software utilizzare, come interpretare i risultati”, spiega Marini. “Nel loro insieme, tutte queste scelte compongono una ‘variabilità analitica’ che può influenzare in modo sostanziale le conclusioni finali di uno studio”.